엔트로피 개념은 너무나도 복잡난해해 ~

💬 최대한 매끄럽게 해석하고자 노력했지만 어색한 문장이 있을 수 있습니다. 피드백은 언제나 환영입니다 🙂

원본 글 주소 : https://towardsdatascience.com/entropy-cross-entropy-and-kl-divergence-explained-b09cdae917a

Entropy, Cross-Entropy, and KL-Divergence Explained!

Let us try to understand the most widely used loss function — Cross-Entropy.

towardsdatascience.com

Cross-Entropy(log-loss라고 하기도 함)는 분류 문제에서 가장 많이 쓰이는 loss function 중 하나이다. 하지만 방대한 자료와 프레임워크가 존재하고 쉽게 사용할 수 있기 때문에 대다수의 사람들은 엔트로피의 핵심 개념을 알지 못한 상태로 문제를 해결하게 된다. 이 글에서는, Entropy 이면에 있는 근본적인 직관을 Cross-Entropy, KL-Divergence와 관련지어 볼 것이다.

Entropy란?

Entropy가 뭘 나타내는지 알기 위해 몇 가지 정보이론의 기초를 살펴보자. 디지털 시대에서 메세지는 비트(0과 1)로 이루어져있다. 메세지로 소통할 때, 우리는 수신자에게 가능한 한 많은 유용한 정보를 보내고 싶어 한다.

Claude Shannon의 논문 "The Mathematical Theory of Communication(1948)"에서 그는 1비트의 정보를 전송하는 것은 수신자의 불확실성을 두 배 줄여준다고 얘기하고 있다.

무슨 말인지 보도록 하자. 예를 들어 날씨가 매일 50(맑은 날):50(비 오는 날)으로 랜덤한 곳이 있다고 가정한다.

만약 기상 관측소가 내일 비가 올 것이라는 정보를 말해준다면 당신의 정보 불확실성은 2배 줄어든다. 처음에는 두 가지가 같은 확률을 가지고 있었지만 기상 관측소로부터 업데이트 된 내용을 받게 되면 한 가지 가능성만 갖게 된다. 기상 관측소는 우리에게 유용한 정보를 보내왔고, 그들이 이 정보를 어떻게 암호화했느냐에 관계없이 이 정보는 사실이다.

전송된 메세지가 'Rainy'고 각 문자가 1바이트씩을 가져 메세지의 전체 크기는 40비트라고 하더라도 유용한 정보는 딱 한 비트만 전달했다.

→ 날씨의 상태가 두 가지 밖에 없기 때문에 0 아니면 1 한 비트로 정보 전달이 가능하다는 의미

이번에는 날씨가 8개의 상태를 가지며 각 날씨의 확률은 모두 같은 상황을 가정해보기로 한다.

이제 기상 관측소가 다음날의 날씨를 알려준다면 당신의 정보 불확실성은 8배 줄어들게 된다. 각 사건들이 발생할 확률이 $\frac{1}{8}$이기 때문에 reduction factor는 8이다.

Reduction factor에 로그를 취하면 필요한 비트 수를 알 수 있다.

하지만 사건 발생 확률이 같지 않다면 어떨까?

맑을 확률이 75%, 비가 올 확률이 25%라면 당신의 정보 불확실성은 4배(2비트의 정보) 줄어든다. 불확실성 감소는 사건 발생 확률의 역수에 해당한다. 이 경우에서는 25%의 역수가 4이므로 $\log_2 4$는 2이고 정보 전달에 필요한 비트 수도 2비트가 된다.

기상 관측소에서 내일은 맑을 것이라고 얘기한다면 우리는 0.41비트(=$\log_2 (0.75)$)의 유용한 정보를 얻을 수 있다. 그렇다면 기상 관측소에서 평균적으로 얼마의 정보를 얻을 수 있을까?

내일 맑을 확률(75%)은 0.41비트의 정보를 주고 흐릴 확률(25%)는 2비트의 정보를 준다. 이 내용을 이용하여 계산하면

$$75%*0.41+25%*2=0.81$$

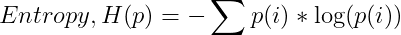

우리는 기상관측소로부터 매일마다 0.81비트의 정보를 평균적으로 얻는다. 방금 계산한 것을 Entropy라고 한다. 이것은 사건들의 불확실성을 나타내는 아주 좋은 척도이다.

만약 우리가 매일 맑기만 한 사막 한가운데 산다면 기상 관측소로부터 많은 정보를 얻지 못할 것이기 때문에 엔트로피는 0에 가까울 것이다. 반면에 날씨 변화가 크면 엔트로피는 훨씬 더 커질 것이다.

Cross-Entropy

이제 Cross-Entropy에 대해 알아보자. 이것은 단지 메시지의 평균 길이에 해당한다. 모두 동일한 확률을 가진 8가지 기상 조건 예시를 고려할 때, 3비트를 사용하여 각각 인코딩할 수 있다.

그럼 이 경우 평균 메시지 길이는 3이고 이것이 Cross-Entropy다.

하지만 만약 당신이 날씨의 확률 분포가 다음과 같은 맑은 지역에 산다고 가정해보자.

매일 날씨가 맑을 확률은 35%, 천둥번개가 칠 확률은 단 1%다. 이 확률분포를 계산하면 Entropy=2.23비트를 얻을 수 있다.

즉 평균적으로 기상 관측소는 3비트의 정보를 전송하지만 수신자는 2.23비트만의 유용한 정보를 얻게 된다. (0.77비트 손실)

이제 다음처럼 코드를 바꿔보자.

이제 맑은 날은 2비트, 약간 흐리거나 먹구름이 많이 낀 날은 3비트, 비가 오는 날은 4비트, 많은 비와 천둥번개가 치는 날은 5비트를 쓸 것이다. 날씨는 명확하게 표현되며 여러 메시지를 이어 사용하면 비트 시퀀스는 단 한 가지로 해석된다. 예를 들어 01100은 부분적으로 맑은 후 가벼운 비가 온다는 의미이다. 기상 관측소가 매일 보내는 평균 비트를 계산하면 2.42비트를 얻을 수 있다.

이것은 세 비트를 사용할 때보다 나은 새롭고 개선된 Cross-entropy이다. 이제 반대로 대부분 비가 오는 다른 지역에서 동일한 코드를 사용한다고 가정하자.

이 상황에서 Cross-entropy를 계산하면 엔트로피의 두 배 가량인 4.58비트를 얻는다. 평균적으로 관측소는 4.58비트를 보내지만 수신자에게는 2.23비트만이 유용한 정보이다. 관측소는 필요한 메시지보다 두 배나 많은 정보를 보내고 있다. 이것은 우리가 사용하는 코드가 날씨 분포에 대한 암묵적인 가정을 하고 있기 때문이다. 예를 들면, 우리가 맑은 날씨에 2비트를 사용할 때, negative binary log(0.25)=2이기 때문에 우리는 맑을 확률이 25%라고 가정하게 된다.

같은 방식으로, 모든 날씨 상황에 대해 계산해보자.

분모에 있는 2의 거듭제곱은 메시지 전송에 사용되는 비트 수다. 예측 분포 q와 실제 분포 p가 다르다는 것은 매우 명백하다.

이제 우리는 Cross-entropy를 실제 확률분포 p와 예측 확률분포 q의 함수로 나타낼 수 있다.

예측 확률의 로그값을 사용한다는 것을 빼면 entropy 식과 비슷해보인다. 예측이 완벽하다면, 즉 예측 분포와 실제 분포가 동일하다면 cross-entropy는 entropy와 같다. 그러나 분포가 다르면 cross-entropy가 엔트로피보다 비트 수만큼 커진다. Cross-entropy가 entropy를 초과하는 양을 상대 엔트로피나 더 일반적으로는 쿨백-라이블러 발산(KL-Divergence)이라고 한다.

추가 자료

'Archive' 카테고리의 다른 글

| [번역] Micro, Macro & Weighted Averages of F1 Score, Clearly Explained (1) | 2022.12.20 |

|---|---|

| [번역] Foundations of NLP Explained Visually: Beam Search, How It Works (0) | 2022.08.01 |

| [번역] Word2Vec Research Paper Explained (0) | 2022.07.04 |

| [번역] Introduction to Stemming and Lemmatization (0) | 2022.04.01 |

| [번역] Attention: Sequence 2 Sequence model with Attention Mechanism (0) | 2022.03.16 |